Anthropic dévoile Opus 4.7 : un modèle d'IA encore plus performant pour le code

Anthropic accélère dans la course à l'IA. Avec Claude Opus 4.7, l'entreprise propose un modèle plus performant en programmation et capable de traiter des images en haute résolution.

Depuis plusieurs mois, Anthropic multiplie les itérations de ses modèles Claude pour rester dans la course face à OpenAI ou Google. À peine deux mois après la sortie d'Opus 4.6, l'entreprise dévoile déjà Claude Opus 4.7, présenté comme son modèle public le plus performant à ce jour.

Disponible dès maintenant pour les utilisateurs professionnels, ce nouveau modèle vise notamment à améliorer les performances en ingénierie logicielle, raisonnement complexe et tâches longues. Toutefois, Anthropic reconnaît que ce système n'est pas le plus puissant qu'elle ait développé…

Des progrès notables sur les benchmarks d'IA

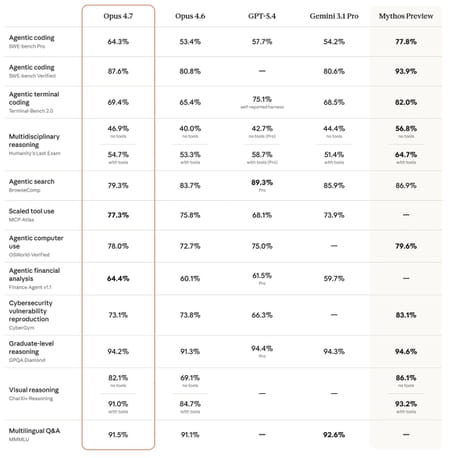

Un aperçu des performances d'Opus 4.7 - Source : Anthropic

Un aperçu des performances d'Opus 4.7 - Source : Anthropic

Comme on peut le lire dans le communiqué de l'entreprise, avec Opus 4.7, Anthropic met en avant plusieurs améliorations mesurables sur les benchmarks de référence. Sur SWE-bench Pro, un test très suivi pour évaluer les performances des modèles en programmation agentique, le modèle atteint 64,3%, contre 53,4% pour Opus 4.6.

Dans certains cas, il se positionne même devant des modèles concurrents. Les comparaisons citées montrent notamment :

- 64,3% pour Opus 4.7 sur SWE-bench Pro

- 57,7% pour GPT-5.4

- 54,2% pour Gemini 3.1 Pro

Sur le benchmark SWE-bench Verified, le score grimpe à 87,6%, tandis que le modèle obtient 94,2% sur GPQA Diamond, un test de raisonnement avancé proche du niveau doctoral.

Au-delà des performances brutes, Anthropic indique également avoir amélioré la capacité du modèle à suivre précisément les instructions et à vérifier ses propres réponses avant de les fournir.

Un modèle pensé pour des tâches longues et autonomes

L'une des orientations principales d'Opus 4.7 concerne les usages dits "agentiques", c'est-à-dire des systèmes capables de réaliser des tâches complexes avec peu de supervision humaine.

Selon Anthropic, le modèle peut gérer des projets multi-étapes sur une longue durée tout en conservant une cohérence sur une fenêtre de contexte pouvant atteindre un million de tokens. Cette capacité lui permet de travailler sur des projets volumineux, comme du développement logiciel ou de l'analyse documentaire.

Par ailleurs, la vision multimodale a été renforcée. Le modèle peut désormais analyser des images jusqu'à 2 576 pixels sur le bord long, soit plus de trois fois la résolution acceptée par les précédents modèles Claude. Cela ouvre la voie à des usages comme l'analyse de captures d'écran complexes ou l'extraction de données depuis des diagrammes détaillés…

Une stratégie en deux niveaux pour les modèles d'Anthropic

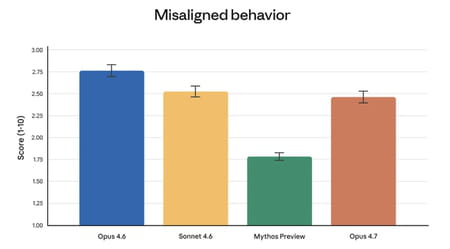

Des capacités impressionnantes... mais pas sur tous les plans - Source : Anthropic

Des capacités impressionnantes... mais pas sur tous les plans - Source : Anthropic

Malgré ces avancées, Anthropic précise qu'Opus 4.7 n'est pas son modèle le plus puissant. En interne, l'entreprise dispose d'un système plus avancé appelé Mythos, actuellement réservé à un nombre limité de partenaires dans le cadre du programme de cybersécurité Project Glasswing.

Ce modèle afficherait des performances encore supérieures, notamment dans les tâches liées à la sécurité informatique. Toutefois, Anthropic a choisi de limiter sa diffusion afin de mieux contrôler les risques liés à ces capacités.

Dans cette stratégie, Opus 4.7 joue donc un rôle intermédiaire : il permet de déployer certaines innovations à grande échelle tout en testant les garde-fous nécessaires avant une éventuelle diffusion de modèles encore plus puissants.

Disponible dès maintenant via l'API Claude, Amazon Bedrock, Vertex AI ou Microsoft Foundry, le modèle conserve la même tarification que son prédécesseur : 5 dollars par million de tokens en entrée et 25 dollars en sortie.