Cloud : Amazon active une instance taillée pour l'intelligence artificielle

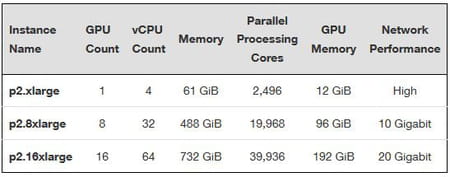

Amazon Web Services livre une toute nouvelle instance taillée pour l'intelligence artificielle. Baptisée P2, elle embarque jusqu'à huit accélérateurs Nvidia (de modèle Tesla K80), chacun entrainant une paire de processeurs graphiques (de type Nvidia GK210). Chaque processeur graphique fournissant 12 Gb de mémoire vive, l'instance peut offrir une mémoire maximum de 192 Gb - avec à la clés 2 496 cœurs mis à contribution en parallèle. A cela s'ajoute une mémoire vive CPU capable de grimper à 732 GB

Dotée d'un dispositif de contrôle de mémoire ECC, "l'instance P2 sera particulièrement adaptée au machine learning, deep learning, calcul de dynamique des fluides, à l'analyse sismique, la modélisation moléculaire, l'analyse du génome ou encore le traitement de tâches financières", égraine Jeff Barr, Chief Evangelist chez Amazon Web Services (lire le post officiel de cette annonce).

Un framework orienté deep learning

En vue de faciliter le déploiement d'applications à base d'intelligence artificielle sur son cloud, Amazon Web Services lance également une image EC2 orientée vers le deep learning. Baptisée Deep Learning AMI, elle embarque plusieurs bibliothèques et frameworks de deep learning (MXNet, Caffe, Tensorflow, Theano et Torch), et une boîte à outils visant à faciliter leur installation et leur configuration sur AWS.

Cette information intervient alors que Google a annoncé la semaine dernière la disponibilité en version finale de son service cloud de machine learning (Google Machine Learning).