Audiobox : les capacités surprenantes du modèle de génération audio de Meta

Textes, images, vidéos et maintenant audio. L'IA générative continue sa progression dans la création de contenus multimédias. Les équipes de recherche en intelligence artificielle de Meta (Facebook) ont présenté fin 2023 un modèle fondation dédié à l'audio. Plus qu'un simple modèle de génération audio, Audiobox gère une multitude de tâches liées à la génération et la modification de fichiers audio. La solution de FAIR (Fundamental AI Research) se décompose en réalité en plusieurs modèles spécialisés : Audiobox SSL (apprend les distributions et corrélations temporelles dans l'audio), Audiobox Speech (pour la génération de paroles) et Audiobox Sound (pour la génération de bruits). La version unifiée de Speech et Sound permet une génération conjointe de parole et de sons.

Un modèle entraîné en quatre étapes

Audiobox SSL, le modèle de base, a été pré-entraîné sur plus de 160 000 heures de parole, 20 000 heures de musique et 6 000 heures d'échantillons sonores (le tout en anglais très majoritairement), sans aucune supervision, sous forme de transcriptions, légendes ou d'étiquettes. Les chercheurs ont ensuite fine-tuné Audiobox SSL sur 100 000 heures de paroles transcrites couvrant divers domaines pour la synthèse de parole guidée par transcription, donnant le modèle Audiobox Speech. Par la suite, l'équipe a également fine-tuné Audiobox SSL sur environ 6 000 heures de données audio avec légendes ou étiquettes pour la génération de sons guidée par texte (prompt). Enfin, les deux modèles fine-tunés ont été fusionnés en un seul : Audiobox. Ce dernier a par la suite été entraîné sur un dataset composé de couples parole / texte, des exemples vocaux supplémentaires, ainsi que des couples données sonores / descriptions textuelles.

Pour l'heure, en janvier 2024, le modèle est rendu disponible sous licence réservée à la recherche à une petite communauté de chercheurs et d'institutions sélectionnés par Meta. Il est possible de faire une demande pour participer aux tests. Depuis le 11 décembre, Meta propose également une subvention visant à promouvoir la recherche en intelligence artificielle responsable et en génération audio. Pour les chercheurs sélectionnés (candidature en ligne jusqu'au 2 février 2023) est donnée la possibilité d'utiliser le modèle ainsi qu'un financement pouvant atteindre 50 000 dollars pour soutenir leurs travaux dans le domaine.

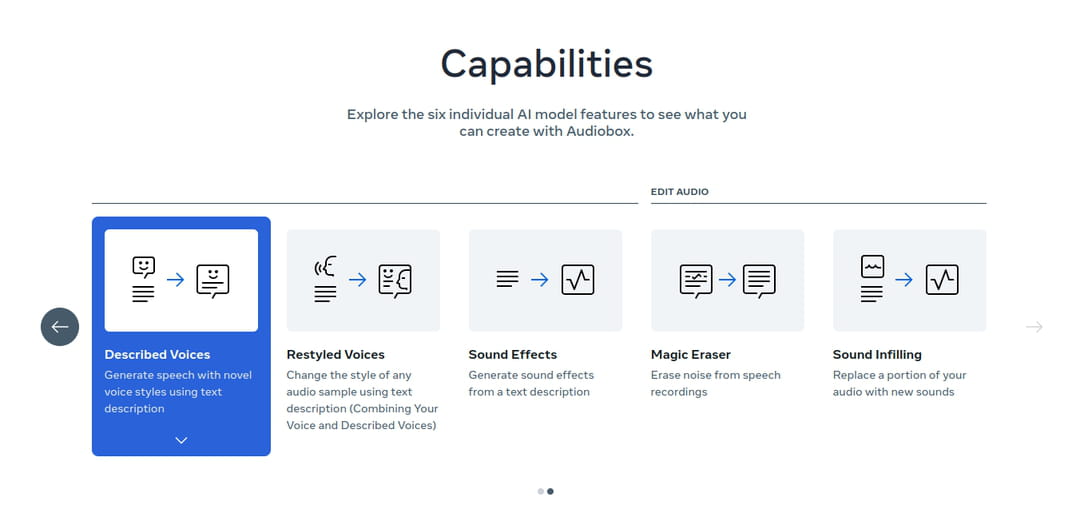

Techniquement le modèle est capable d'effectuer une grande variété de tâches de générations et d'éditions : text-to-speech, text-to-sound, édition d'audio guidée par prompt, transfert de style vocal (le modèle reçoit 3 éléments en entrée : la transcription textuelle, un exemple audio d'une voix source et une description textuelle du style/environnement souhaité) et génération non-contrainte de parole (le modèle reçoit en entrée uniquement la transcription de la phrase à synthétiser vocalement, sans autre forme de conditionnement).

Un outil de démonstration proposé par Meta

Comme à son accoutumé, Meta a mis à disposition du public un espace de démonstration pour tester les capacités du modèle depuis ses serveurs. Nous avons pu tester certains outils avec des échantillons vocaux, les premiers résultats sont assez convaincants. La démonstration propose six fonctionnalités basées sur Audiobox. La première, intitulée "Your Voice", permet de produire une copie virtuelle de sa voix pour pouvoir ensuite générer des paroles synthétiques (text-to-speech personnalisé). Pour commencer, l'outil nécessite un bref enregistrement vocal dans lequel vous lisez une phrase en anglais. Après que le modèle ait traité cet enregistrement, vous pouvez fournir un texte à lire. L'intelligence artificielle produit alors une version audio du texte saisi, imitant de manière assez précise votre voix. Selon nos tests, la version produite est assez fidèle à la voix originale.

Autre outil, "Described Voices" permet du text-to-speech intelligent. L'outil attend par défaut le texte à lire et une description textuelle du style vocal attendu. Nous avons par exemple demandé à l'outil de lire une phrase en utilisant la voix d'un homme avec un fort accent français. Le résultat est assez surprenant et plutôt fidèle à la demande initiale. En revanche, selon nos tests, le modèle a tendance à produire des fichiers au gain variable, parfois très fort ou trop faible, rendant nécessaire le traitement sonore du fichier après téléchargement.

De son côté, "Restyled Voices" permet de lire une phrase en modifiant votre style vocal. Il est possible de changer l'accent, l'ambiance sonore de l'enregistrement en utilisant directement un prompt.

Plus classique, Audiobox permet également de générer des bruitages. Sonnette, cascade d'eau, coups de feu… Le modèle génère avec une qualité relativement bonne une grande variété de sons avec un simple prompt textuel. Le modèle de Meta permet également de nettoyer un enregistrement vocal des bruits parasites. Il suffit d'enregistrer son fichier vocal et de sélectionner par la suite les bruits à supprimer (préalablement identifiés par le modèle). Enfin, le module "Sound Infilling" permet de remplacer une section de fichier audio par un nouveau son, toujours en utilisant une description textuelle (prompt).

Au vu de ces premières démonstrations, Audiobox semble très prometteur et ouvre la voie à des avancées significatives pour la génération audio. Bien que pour l'instant réservé à la recherche, ce modèle pourrait à terme trouver de nombreuses applications business, notamment dans les domaines du marketing, de la synthèse vocale personnalisée, de la post-production audio ou encore dans la sonorisation en temps réel.