LinkedIn et l'IA générative : vos données valent de l'or, mais qui encaisse ?

LinkedIn a récemment introduit une fonctionnalité passée presque inaperçue… mais qui dit tout de notre époque. Par défaut, vos contenus peuvent désormais servir à entraîner des modèles d'IA ..

LinkedIn a récemment introduit une fonctionnalité passée presque inaperçue… mais qui dit tout de notre époque.

Par défaut, vos publications, vos commentaires, vos interactions peuvent désormais servir à entraîner des modèles d’intelligence artificielle générative.

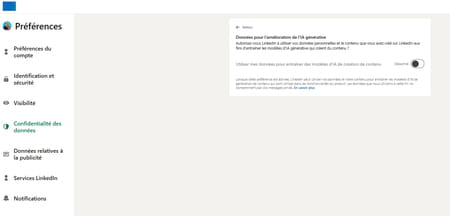

La subtilité ? La case est pré-cochée.

Autrement dit, sans le moindre geste de votre part, vos idées, vos analyses, vos histoires professionnelles deviennent le carburant d’une machine dont vous ne contrôlez ni l’usage, ni les retombées.

C’est plus qu’un détail technique c’est un symbole !

Le consentement par défaut : un mirage

Le cœur du sujet n’est pas l’IA en elle-même. L’IA est une révolution technologique majeure. Elle peut augmenter notre créativité, accélérer nos processus, et ouvrir des opportunités inédites

Et c’est bien là le vrai sujet :

Ce n’est pas l’IA qu’on remet en question.

C’est la manière dont on nous embarque sans rien dire.

Parce que le consentement par défaut n’est pas un consentement.

C’est une absence de choix, habillée en option technique.

Je ne suis pas anti-IA.

J’ai suivi plus de 900 heures de formation.

Je suis certifiée chef de projet IA par l’État.

Je suis pro-tech ET pro-futur !

Mais là, on ne parle pas de technologie.

On parle de respect.

De souveraineté numérique.

D’intégrité intellectuelle.

Vous écrivez.

Vous commentez.

Vous partagez.

Et sans le savoir, vous alimentez gratuitement une machine qui peut demain vous reproduire, vous imiter… voire vous effacer.

Le problème est ailleurs : dans la manière dont LinkedIn a choisi d’imposer ce consentement par défaut.

Car qu’est-ce qu’un consentement qu’on ne formule pas, sinon une absence de choix réel ?

C’est une logique que l’on retrouve souvent dans la tech : activer d’office une fonctionnalité, puis laisser à l’utilisateur le soin de s’y opposer. C’est efficace pour la plateforme. Mais est-ce éthique pour autant ?

Une ressource stratégique exploitée gratuitement

En réalité, LinkedIn ne fait que formaliser une vérité déjà connue : nos données, nos contenus, nos interactions sont des ressources stratégiques.

Sans nous, sans nos contributions, la plateforme n’aurait aucune valeur.

Et désormais, ces contributions nourrissent des IA capables de générer des posts, des synthèses, voire demain des profils entiers.

Mais cette valeur captée par LinkedIn et par extension Microsoft ne nous est pas redistribuée.

C’est une économie à sens unique.

Pourtant, d’autres industries ont montré qu’il est possible de rémunérer les créateurs :

Spotify paie les artistes pour chaque écoute.

YouTube reverse une partie des revenus publicitaires aux vidéastes.

TikTok soutient ses influenceurs via des fonds de création.

Pourquoi LinkedIn, qui se nourrit d’un public professionnel et de contenus à haute valeur intellectuelle, ne devrait-il pas adopter le même principe ?

Le risque d’une dépossession intellectuelle

Au-delà de la question économique, il y a une autre inquiétude : celle d’une dépossession progressive de notre production intellectuelle.

Demain, des IA entraînées sur nos données pourront générer des posts similaires aux nôtres, des analyses comparables à celles que nous publions.

La frontière entre ce qui vient d’un professionnel humain et ce qui sort d’une machine deviendra floue.

Ce n’est pas seulement un enjeu de reconnaissance individuelle.

C’est un enjeu de confiance collective : comment distinguer l’expertise authentique de la copie générée ? Comment garantir que la valeur d’un réseau professionnel repose encore sur des humains, et non sur des algorithmes recyclant leurs traces ?

Vers une nouvelle économie de la donnée

L’affaire LinkedIn n’est pas isolée. Elle illustre une tendance de fond : les géants du numérique cherchent à constituer des bases de données massives pour nourrir leurs IA.

Les coûts d’acquisition de données étant énormes, il est plus simple et plus rentable d’utiliser celles des utilisateurs déjà captifs.

Mais ce modèle ne pourra pas durer éternellement.

Car à mesure que les citoyens, les professionnels et les créateurs prennent conscience de la valeur de leurs contributions, une exigence va émerger : celle d’une économie plus équitable de la donnée.

Trois pistes sont déjà évoquées dans le débat public :

Une transparence totale : que les plateformes indiquent clairement quelles données sont utilisées, dans quel but, et avec quelles limites.

Une rémunération partagée : que les utilisateurs dont les contenus servent à entraîner des IA perçoivent une part de la valeur créée.

Un cadre légal renforcé : que la régulation impose des standards de consentement actif et explicite, plutôt que des options par défaut.

Que faire aujourd’hui, concrètement ?

En attendant, chaque utilisateur dispose d’un pouvoir immédiat : décocher la fameuse option dans ses paramètres.

Ce n’est pas un geste de défiance envers l’IA.

C’est un geste de souveraineté numérique.

Ce choix vous permet de décider si vous acceptez que vos données participent gratuitement à un projet dont vous ne maîtrisez ni les contours ni les bénéfices.

Mais surtout, c’est l’occasion de se poser une question plus large : quelle valeur accordons-nous à nos propres contributions en ligne ?

L’heure de vérité

Ce qui se joue aujourd’hui dépasse LinkedIn.

C’est une bataille culturelle et économique autour de la valeur de nos données, de nos idées, de nos expertises.

Pendant trop longtemps, les plateformes ont imposé un modèle où l’utilisateur est à la fois client, produit et fournisseur de matière première.

Il est temps de changer de paradigme.

???? Soit nous acceptons de céder notre intelligence collective gratuitement.

???? Soit nous revendiquons notre place dans la chaîne de valeur.

Car nos données ne sont pas de simples résidus numériques.

Elles sont le socle d’une nouvelle économie.

Et cette économie doit se construire avec nous, pas contre nous.