- Des dizaines de voitures autonomes deviennent folles et envahissent une impasse

- SNCF : malgré 23 ans d'ancienneté, ce salarié est licencié pour faute grave après une erreur de 25€ dans sa caisse

- Ce salarié pensait toucher 50 000 euros après une victoire en justice : voici ce qui lui reste après les impôts

- Plus grand que l'Europe, ce continent englouti s'étend sous le sol français : il abrite des espèces inconnues

- Elle est simple témoin d'un harcèlement chez McDonalds, elle sera indemnisée comme victime : la Cour de cassation change la donne

- Un virement de 466 euros arrive sur le compte en banque de 3 millions de familles : certains parents doivent le réclamer à la CAF

- Le gouvernement alerte les propriétaires : les maisons dans le Gard et la Haute-Marne pourraient perdre leur valeur immobilière

- PureTech : la réparation automobile remboursée à 80%, une association révèle comment payer moins cher au garage

En direct

Databricks va investir plus de 300 millions de dollars en France

Stellantis étend son partenariat avec Palantir pour optimiser la gestion de ses données

La Cour de justice de l’Union européenne désavoue le système de fichage français

Taïwan estime "impossible" de déplacer 40% de sa production de puces aux États-Unis

Databricks relève ses prévisions de ventes, portant sa valorisation à 134 milliards de dollars

Cloudflare lance une plateforme de données sans frais de sortie

Databricks étend ses outils de gouvernance et d'évaluation des agents d'IA

Palantir dépasse les estimations et relève ses prévisions pour le T4

Palantir poursuit d'anciens ingénieurs qui souhaitent lancer une start-up copycat

L'action Palantir a augmenté de 1700% depuis ses débuts à la Bourse de New York il y a cinq ans

Le spécialiste des bases de données PostgreSQL, Supabase, lève 100 millions de dollars

-

-

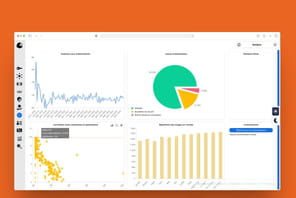

Snowflake met l'IA au service de la data

A l'occasion de son événement qui s'ouvre ce 1er juin à San Francisco, le spécialiste du big data lève le voile sur une série de nouveautés. Objectif : faciliter la gestion de données en masse.

-

-

-

RGPD, sept ans après : comment gagner la confiance des utilisateurs ?

Un paradoxe persiste : jamais les utilisateurs n'ont été aussi protégés juridiquement et jamais la défiance envers les applications numériques n'a été aussi forte.

-

-

-

-

-

-

- Il roule sur l'autoroute quand sa voiture s'arrête net : 3 ans plus tôt, son garagiste avait oublié quelque chose dans le moteur

- 2 jours de congés supplémentaires par enfant à charge : les parents salariés ignorent qu'ils ont ce droit

- Il meurt sans héritier : des cousins éloignés récupèrent un coffre de pièces d'or valant 2,5 millions d'euros